Vedeli ste, že už v roku 1950 položil Turing túto otázku, keď navrhol svoj slávny Turingov test? O pár dekád neskôr vznikol prvý chatbot naprogramovaný ako psychoterapeut. Volá sa Eliza. No a čo dnes? Dnes máme celý rad aplikácií ako Woebot, Replika či Wysa, ktoré sľubujú emocionálnu podporu bez čakania alebo akejkoľvek stigmy.

Ale dokážu naozaj poskytnúť to, čo potrebuje človek v zlom emočnom období? V období, kedy potrebuje pochopenie, vypočutie a skutočnú ľudskú podporu? A čo v prípade, keď je problém zložitejší než len pár pochmúrnych dní?

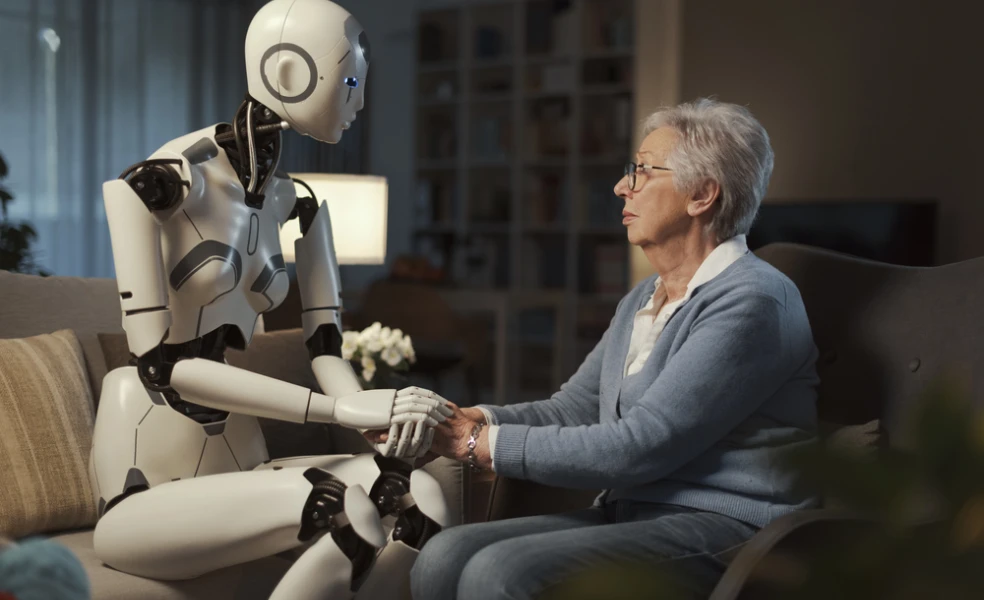

V digitálnom veku a v roku 2025, kedy ide AI stále viac a viac do popredia, si kladieme otázku: môže umelá inteligencia (AI) nahradiť terapeutov? A mala by vôbec?

Výhody AI‑terapie: dostupnosť, anonymita a rýchlosť

AI nástroje ponúkajú podporu 24/7, čo ocenia ľudia s hektickým rozvrhom alebo žijúci mimo veľkých miest, kde sú terapeuti nedostupní, resp. musia za nimi cestovať niekoľko kilometrov či hodín. Ich nízka cena či dokonca bezplatné verzie lákajú hlavne mladšiu generáciu, ktorá nechce čakať mesiace na termín u terapeuta. Veď predsa sme si zvykli mať všetko rýchlo.

Navyše, konverzácia s chatbotom môže byť pre niektorých menej stresujúca ako otvorenie sa človeku - anonymita totiž znižuje stigmu a človek sa môže uvoľniť už pri prvom kroku. Okrem toho AI dokáže zozbierať údaje o nálade či správaní používateľa a poskytovať personalizované spätné väzby.

Obmedzenia AI: chýba empatia, kontext a emocionálna hĺbka

Napriek technologickému pokroku AI nedokáže nahradiť skutočnú empatiu a emocionálne naladenie. To dokáže poskytnúť iba kvalifikovaný terapeut. Keď ide o komplexné problémy alebo traumy spojené so stresom, úzkosťou či samovraždou, AI rozhodne nestačí.

Navyše sa môže stať, že algoritmy nebudú rozumieť kultúrnym, individuálnym alebo psychologickým nuansám, čím budú generovať nerelevantné či potenciálne škodlivé odpovede. Ako upozorňujú odborníci, bez osobného kontaktu sa stráca vzťah a terapeutický proces, ktorý často prináša rast.

DepositphotosEtické riziká a ochrana súkromia: Keď osobné dáta nie sú len čísla

Na prvý pohľad pôsobia terapeutické chatboty nevinne - stačí si s nimi písať a oni počúvajú, dávajú spätnú väzbu, povzbudzujú. Ale za touto interakciou sa skrýva množstvo etických otázok, ktoré sú čoraz pálčivejšie. Prečo? Pretože používateľ v emocionálne zraniteľnom stave zdieľa intímne, citlivé informácie, ktoré by inak povedal len dôveryhodnému odborníkovi alebo blízkej osobe.

A tieto dáta nezostávajú len v rozhovore - sú uchovávané, analyzované, niekedy aj predávané alebo použité na trénovanie ďalších modelov. S tým ale prichádza kopa iných otázok a problémov.

1. Zneužitie dát a komerčné praktiky

Nie všetky AI aplikácie spĺňajú normy určené pre zdravotnícke zariadenia. To znamená, že sa nemusia riadiť rovnakými pravidlami ako psychológovia alebo psychiatri. Niektoré služby v podmienkach používania pripúšťajú, že údaje môžu byť použité na vývoj produktov, niekedy dokonca aj na cielenú reklamu. A to môže predstavovať priame porušenie dôvernosti - základného princípu akejkoľvek psychologickej pomoci.

Predstavte si situáciu, keď používateľ v dôvere popíše svoju úzkosť spojenú s telesnou nedostatočnosťou a o pár dní mu začne vyskakovať reklama na výživové doplnky či estetické zákroky. Nie je to síce nezákonné, ale je to neetické a tiež manipulatívne.

2. Nedostatočná ochrana pred únikom informácií

AI systémy sú síce čoraz lepšie zabezpečené, no stále existuje riziko únikov dát, či už hacknutím, technickým zlyhaním, alebo internou chybou v spoločnosti. A na rozdiel od bežného hesla či e-mailu, únik duševných zápiskov, detailov o traume alebo myšlienok na smrť môže mať nezvratné následky - od sociálneho znevýhodnenia po zneužitie informácií v pracovnom prostredí.

V kontexte ochrany zdravia ide o veľmi citlivú kategóriu údajov. Pri tradičnej terapii máte záruku mlčanlivosti, pri AI službe často nemáte kontrolu nad tým, kto k údajom pristupuje, a to aj v prípade zmazania aplikácie alebo účtu.

3. Právna zodpovednosť je nejasná

Ak by AI terapeut poskytol nesprávnu radu, povedzme, že by odporučil izoláciu namiesto vyhľadania odbornej pomoci, kto je za to zodpovedný? Vývojár? Prevádzkovateľ platformy? Používateľ, ktorý si zle vyložil odpoveď? Tu vstupujeme na šedú právnu zónu, ktorú aktuálne legislatíva len postupne začína riešiť. V prípade ľudského terapeuta existujú etické kódexy, licencie, súdne postupy - v prípade AI to tak zatiaľ nie je.

4. Ilúzia bezpečného priestoru

Chatbot môže vytvárať falošný pocit bezpečia. Používatelia majú dojem, že sú anonymní, že ich nikto nesleduje, že môžu všetko povedať. Lenže všetko, čo povedia, je zaznamenané. Navyše, AI nedokáže rozoznať hranicu medzi vážnym stavom a „len“ znepokojením, a preto môže neúmyselne utvrdiť človeka v tom, že je v poriadku, hoci by mal v skutočnosti okamžite vyhľadať odbornú pomoc. Je to veľmi tenký ľad.

DepositphotosRegulácie: Čo hovorí zákon v EÚ?

V rámci Európskej únie sa pripravuje AI Act - prvý komplexný legislatívny rámec pre umelú inteligenciu, ktorý zahŕňa aj jej využitie v zdravotníctve a terapii. Ak bude AI nástroj klasifikovaný ako vysokorizikový, bude musieť spĺňať prísne kritériá bezpečnosti, transparentnosti a etickej zodpovednosti.

Navyše, všetky aplikácie pôsobiace v EÚ musia dodržiavať GDPR - teda spracúvať údaje používateľov s ich súhlasom, umožniť ich odstránenie a zabezpečiť ich pred zneužitím. Problém nastáva, keď sú tieto aplikácie mimo EÚ právomoci alebo keď nie sú jasne deklarované ich právne zodpovednosti.

Kam smeruje AI terapia?

Otázka, ktorá ostáva v oblakoch ... No v najbližších rokoch možno očakávať nástup multimodálnych AI terapeutov - teda takých, ktorí budú vnímať nielen slová, ale aj intonáciu hlasu, mimiku, reč tela či srdcový tep pomocou wearables. Technológie ako virtuálna realita (VR) môžu pridať nový rozmer - napríklad vystavenie sa fóbiám v bezpečnom prostredí.

Zároveň sa rozvíjajú hybridné modely, kde AI pripraví podklady, zaznamená nálady klienta počas týždňa, a terapeut ich využije počas sedenia. To môže zvýšiť efektivitu terapie a umožniť hlbšiu personalizáciu. Otázka však zostáva: Chceme AI, ktorá simuluje empatiu až tak dokonale, že nevieme, či ide o človeka? Alebo chceme technológiu, ktorá nám len pomáha - a zároveň necháva priestor na ľudskosť? Myslím, že odpoveď je jasná.

AI ako doplnok, nie náhrada

AI môže poslúžiť ako podporný nástroj - napríklad analyzovať denné myšlienky, sumarizovať svoj denník alebo poskytovať rámec na reflexiu. Ale samotný liečivý vzťah - ten s vlastnosťami a slovami ako neistota, zlom a náprava - AI nedokáže napodobniť.

Práve protiklady v terapeutickom vzťahu často vedú k hlbšiemu rastu. Pre generáciu Z môže byť AI intuitívnym riešením, no riziká emocionálneho straty, schopnosti sebareflexie či prehnanej závislosti na algoritme sú viac než reálne.

AI môže pomôcť. Ale nemala by nahradiť. A tu je ten zásadný rozdiel. Technológia prináša nespočetné výhody: dostupnosť, anonymitu či cenovo prijateľnú podporu. Môže poslúžiť ako prvý krok, ak máte problém, alebo ako doplnok k psychoterapii.

Ale v prípadoch závažného psychického stavu, traumy alebo emocionálnej straty je kontakt s kvalifikovaným terapeutom nenahraditeľný. Pre skutočnú liečbu, rast a autenticitu nepotrebujeme stroje, potrebujeme ľudí.

Zdroj úvodnej fotky: Depositphotos

0 komentárov